你是否常用 ChatGPT 幫你查今天的新聞、找最新價格? 這些資訊不是模型「想出來」的,而是靠內建工具去抓資料。GPT-5.5 把可用工具從幾個擴充到整整十種,但哪些工具一般人就能用、哪些要寫程式才能開,官方文件說得比較散,這篇把它整理清楚。

GPT-5.5 支援哪些工具?

GPT-5.5 目前支援以下十種工具:

| 工具 | 功能 | 適合誰 |

|---|---|---|

| Web search | 即時搜尋網路 | 一般用戶 / 開發者 |

| File search | 搜尋上傳的文件 | 一般用戶 / 開發者 |

| Image generation | 生成圖片 | 一般用戶 / 開發者 |

| Code interpreter | 執行程式碼、處理資料 | 一般用戶 / 開發者 |

| Computer use | 控制電腦操作介面 | 一般用戶 / 開發者 |

| MCP | 連接外部系統(Notion、資料庫等) | 一般用戶 / 開發者 |

| Apply patch | 套用程式碼修改 | 開發者 |

| Skills | 可重複呼叫的自訂工作流程 | 開發者 |

| Hosted shell | 在雲端伺服器執行指令 | 開發者 |

| Tool search | 動態載入工具定義 | 開發者 |

「一般用戶」指的是直接在 ChatGPT 網頁或 app 使用,「開發者」則需要透過 Responses API 寫程式才能呼叫。前五種在 ChatGPT 的 agent mode 下都可以啟用,後五種目前是純 API 功能。

web search:查最新資料最快的方式

web search 是這十種工具裡對一般人最直接有感的一個。開啟後,模型可以在回答問題時自動上網搜尋,答案會附上來源連結。

在 ChatGPT 介面,agent mode 下這個功能預設就會根據需要啟用。如果你是開發者,Responses API 的啟用方式是把 web_search 加入 tools 清單:

{

"model": "gpt-5.5",

"tools": [{"type": "web_search"}],

"input": "台灣 2026 年 GDP 成長率"

}幾個細節值得注意:

- 可以過濾來源網域:只讓它搜特定網站,或封鎖某些網站,避免引用到不可靠來源

- 有地區設定:可以指定搜尋結果要以哪個地區為準

- 支援即時資料:運動比分、天氣、金融數據都可以查到當下最新狀態

- 搜尋視窗上限 128k:GPT-5.5 本身支援 1M token 的 context,但 web search 抓回來的內容最多只占 128k,這個限制和模型大小無關,固定如此

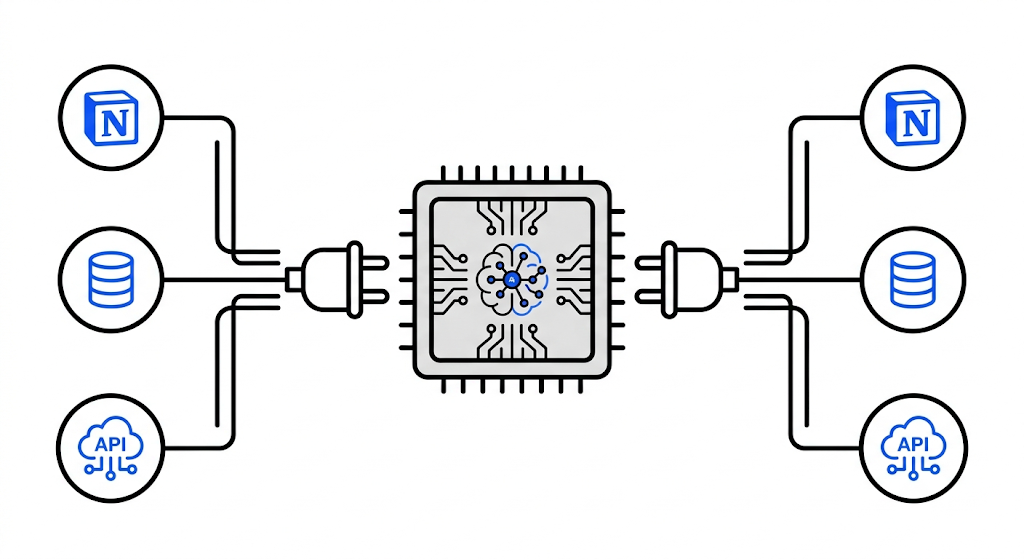

MCP:讓 AI 連到你自己的系統

MCP 全名 Model Context Protocol,是一個開放標準,設計目的是讓 AI 模型連接到外部系統,比如你自己的 Notion 工作區、公司內部資料庫、或任何提供 MCP 介面的第三方服務。

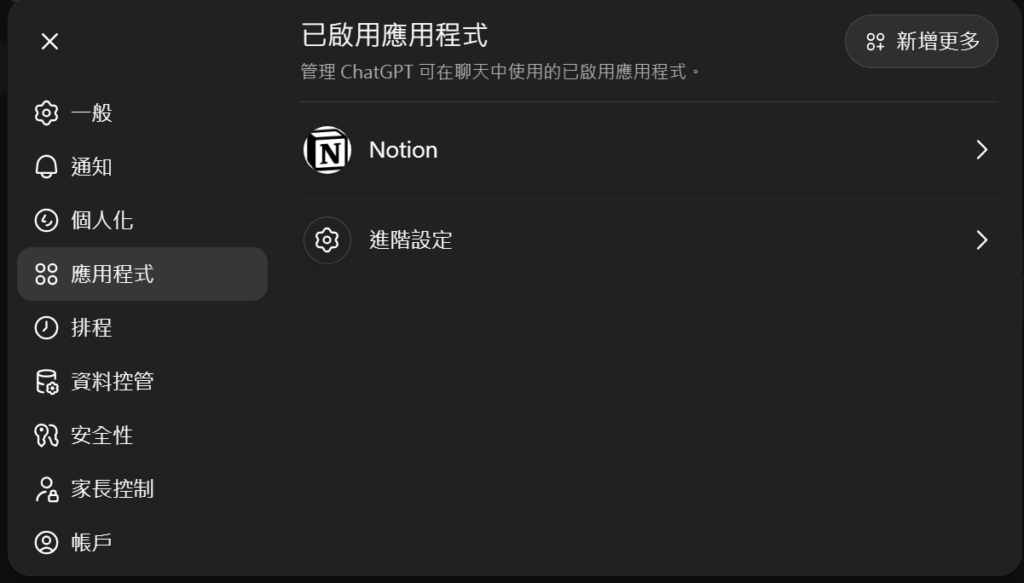

MCP 的使用路徑依方案不同而有差異:

一般用戶(Plus / Pro):2026 年 3 月後,ChatGPT 推出 Developer Mode,可以在「設定 → Apps」裡連接自訂 MCP server。讀取和寫入操作都支援,但寫入動作執行前會先跳出確認視窗讓你核准。

Business / Enterprise 用戶:同樣透過 ChatGPT 介面設定,有完整的讀寫功能。

開發者(Responses API):彈性最高,可以在程式碼裡直接指定 MCP server:

{

"tools": [{

"type": "mcp",

"server_url": "https://your-service.com/sse/",

"allowed_tools": ["search", "fetch"]

}]

}設定裡幾個關鍵參數:

- server_url:你的 MCP server 位址,使用 SSE 傳輸協定

- allowed_tools:指定這個 server 上開放哪些工具給模型用,可以只開其中幾個,不用全部開啟

- require_approval:控制模型每次用工具前要不要人工確認,自動化流程通常設

"never"

MCP 的概念類似「幫 AI 裝插頭」,插頭(MCP server)是標準化的,任何系統只要實作這個介面,就能讓模型直接操作你的資料或服務。

不管是哪條路徑,都需要先有人架好一個 MCP server 才能接上去用。ChatGPT 介面的 Developer Mode 適合不想寫程式但想連接外部系統的 Plus/Pro 用戶;如果需要寫入權限或更複雜的整合,才需要走 Responses API 路線。

tool search:工具太多時的省錢方案

這個功能比較偏技術面,但值得提一下,因為它直接影響到使用 MCP 的成本。

如果你在用 API 建一個有很多工具的 AI agent,會碰到一個問題:每次呼叫都要把所有工具的定義塞進 context,光是說明文字就可能占幾萬個 token,還沒開始做事就先花了一大筆。

tool search 的做法是讓你把部分工具標記為「延遲載入」,模型在真正需要用某個工具時,才把那個工具的完整定義拉進來。平時只帶一份輕量的工具清單,用到哪個再查哪個。

和 MCP 搭配時,這個差異特別明顯。一個 MCP server 可能有幾十個工具,每個都有完整的參數說明;有了 tool search,cache 可以跨請求重複利用,整體 token 消耗低很多。gpt-5.4 以後的模型都支援這個功能,包含 GPT-5.5。