用了 Claude Opus 4.7 之後發現它查資料、整合資訊的能力好像不如以前?你感覺到的不是錯覺。Opus 4.7 在網路搜尋這塊確實出現了可量化的退步,而且 Anthropic 在發佈公告裡根本沒有正面提這件事。

這篇文章會說清楚退步有多嚴重、為什麼會發生,以及你要不要因此繼續留在 4.6。

本文重點

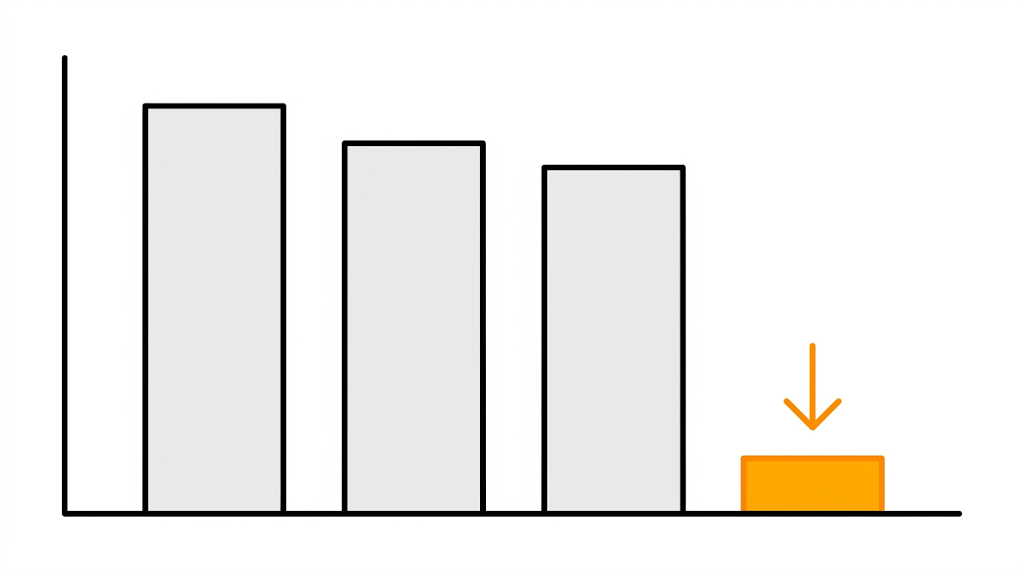

- Opus 4.7 在 BrowseComp(Anthropic 自家的網路研究 benchmark)從 83.7% 跌到 79.3%,是所有 benchmark 裡唯一明顯倒退的項目

- 這是訓練取捨的結果:強化 coding 和代理任務的同時,讓模型在跨來源推理上變弱

- 如果你的工作流程大量依賴網路搜尋和多來源整合,建議先測試再升級,或考慮留在 4.6

退步有多嚴重?數字說話

衡量 AI 做網路研究的標準 benchmark 叫 BrowseComp。這個測試要求模型自己搜尋、讀取多個網頁,然後整合成有引用來源的答案,模擬的是你叫 AI 幫你查一件複雜事情的過程。

| 模型 | BrowseComp 分數 |

|---|---|

| GPT-5.4 Pro | 89.3% |

| Claude Mythos Preview | 86.9% |

| Gemini 3.1 Pro | 85.9% |

| Opus 4.6 | 83.7% |

| Opus 4.7 | 79.3% |

Opus 4.7 下降了 4.4 個百分點,在 Anthropic 公布的所有 benchmark 裡,這是唯一明顯倒退的一項。

其他競爭對手的分數擺在旁邊更清楚:GPT-5.4 Pro 跟 Gemini 3.1 Pro 都在 85–89% 的區間,Opus 4.7 的 79.3% 在這份榜單上是墊底的。

退步長什麼樣子?三個具體症狀

光看數字還是很抽象。實際測試反映出來的問題有三個面向:

來源歸屬搞混

多份文件同時丟給 4.7 的時候,它比 4.6 更容易把某個說法歸到錯誤的來源。舉例來說,同時看三篇報告,它有時會說「根據 A 報告」,但那個資訊其實來自 B 報告。這個問題在 4.6 少見得多。

矛盾偵測變弱

4.6 遇到兩個來源互相矛盾,通常會主動標注「這兩份資料說法不一致」。4.7 反而傾向把衝突的說法融合成一個「兩個都是真的」的答案,把問題藏起來而不是指出來。對於要做研究的人來說,這其實更危險。

引用變得含糊

4.7 給的答案更常是改寫原文的「解釋」,而不是直接引用原文字句。表面上讀起來可能更流暢,但查核的時候你會發現很難回溯到原始來源。

為什麼會這樣?訓練的代價

Opus 4.7 的訓練目標很明確:把 coding 能力和代理任務的穩定性推高。結果確實做到了,SWE-bench(衡量軟體工程任務的 benchmark)從 4.6 的 53.4% 跳到 4.7 的 64.3%,漲了將近 11 個百分點。

問題是,要讓模型在長時間的代理任務中更持久、更穩定,訓練資料需要大量的工具使用軌跡和程式碼任務。這個方向的訓練,客觀上會讓模型少一點那種「停下來、比對多個來源、標注矛盾」的謹慎。兩者不是完全相容的能力。

Anthropic 在官方發佈公告裡沒有提 BrowseComp 的退步。這本身就說明了一些事。

那我還需要用 4.7 嗎?

看你的主要用途。

繼續用 4.7 或升級的情況:你主要拿 AI 做 coding、跑代理流程,或長多步驟任務。4.7 在這些地方明顯比 4.6 好。

考慮留在 4.6 或測試再說的情況:你的工作流程很依賴 AI 去查資料、整合多個來源、寫有引用的報告。這塊 4.6 目前還是比 4.7 好。

值得注意的是,BrowseComp 的分數對測試環境設定很敏感,如果你的系統有特定的工具使用架構,實際差距可能和 benchmark 不完全一樣。建議用自己的典型任務跑幾個對比測試,不要純靠 benchmark 決定。